自分用読むべき論文メモ 2019年6月版

しばらく論文読んでる暇がなかったので、面白かったTwitterの記事を中心に。(いつも、ほぼそうですが。。。)

タコの8本足は「それぞれが独立したCPUを持つ分散型ネットワーク」だという研究結果https://t.co/ADTQSQvSO7

— GIGAZINE(ギガジン) (@gigazine) June 30, 2019

タコはどうやって腕を動かしているのか(AGU宇宙生物学会議AbSciConの発表)https://t.co/tcHMaeYvoO

— ゆきまさかずよし (@Kyukimasa) June 26, 2019

腕ごとにある大きな神経節が環状に接続していて主脳を経由せずに分散型処理してる。

「自分の腕の位置を脳が知っていなくても、腕同士は知っている」 pic.twitter.com/qFvJUitg0C

研究者注目の的、タコ。

Some code releases before I head off to vacation :)

— Angjoo Kanazawa (@akanazawa) June 29, 2019

Skill from Video data + motion reconstruction code: https://t.co/acXbzikaz6

CVPR'19 human motion paper training code: https://t.co/dTHoMO2m1R

Thanks to @jasonyzhang2, Panna, @xbpeng4 for the team effort.

Have a nice July! pic.twitter.com/t4IxyeSqER

長らくお待たせしました。ついに刊行。 細馬宏通・菊地浩平編『ELAN入門 言語学・行動学からメディア研究まで』(ひつじ書房、2019.6)。使い方のみならず、時間分析の基本から時系列データの扱いまで。映像と音声を分析するすべての方に。どうぞ。 https://t.co/WSwLvcnq1p

— 細馬宏通/ELAN入門(ひつじ書房) (@kaerusan) June 17, 2019

突然変異がどのように集団に広がり生物が「進化」するのかを「グラフ理論」で解き明かす試み(2018)https://t.co/NB9IbpvCI9

— GIGAZINE(ギガジン) (@gigazine) June 27, 2019

進化が明示的にコントロールされるようになったら、ますますやばい。

一部しか観測できない環境下(POMDPs)では過去の観測列から現在の状態信念を計算する。この信念からの長期の予測タスクを解くことで時間的に一貫性がある信念が得られ、地図や自己位置も復元可能。この信念を元にした強化学習はデータ効率がよい https://t.co/zbkyaMlSbB https://t.co/HqyL8zkIBQ

— Daisuke Okanohara (@hillbig) June 27, 2019

Dependenciesを使うといいらしい。Dependency WalkerをWindows 10用に書き直したものhttps://t.co/mNUHrhs7YN

— 中村 薫(Kaoru Nakamura) (@kaorun55) June 23, 2019

基本ツール

Mode Seeking Generative Adversarial Networks for Diverse Image Synthesis

— Shigekazu Ishihara (@shigekzishihara) June 22, 2019

cGANのモード崩壊(同じ画像ばかり生成される問題)を解決し,多様性を持たせることを目的としたMSGAN https://t.co/L8UFUXAsSX

これすごい。英語の単語やフレーズを入力すると大量の YouTube の動画から実際に使われている部分だけを検索して見せてくれる。文脈もあるから使われ方も分かる。固有名詞の発音が分からない時、発音の苦手な単語を文脈と共に練習したい時に使えそう YouGlish https://t.co/CL0f9HpDqO

— Masato Hagiwara (萩原正人) (@mhagiwara_ja) June 22, 2019

We just released PoseNet 2.0 with TensorFlow.js, including a much more accurate ResNet-based model!

— TensorFlow (@TensorFlow) June 21, 2019

Try the live demo by @tylerzhu3, @oveddan, @greenbeandou, @dsmilkov, @ire_alva, @nsthorat → https://t.co/Dgz0kay40U

Learn more here → https://t.co/JDs5wIeByP pic.twitter.com/MWfadJLk97

ちなみに浅井先生の資料はこっちのほうが面白かった。p8ぐらい「制御に苦手意識を持ったまま卒業させると、制御に無理解な層を拡大再生産することになる」 企業で制御屋やるの辛い理由これか!と納得。https://t.co/wwpUoWkKaG

— モータ制御マン (@motorcontrolman) June 22, 2019

Googleの世界最大の画像データセット「Open Images v4」の概要や使い方のまとめhttps://t.co/V4YRXc687K

— marsee101 (@marsee101) June 21, 2019

あもりにも速すぎて熟語にも強い辞書ツールMouse Dictionaryですが、自分で使っていて追加したい機能や感じる不満がもうなくなったので、利用者からの要望等ありましたら教えてください😉https://t.co/fjtzmoOY4r pic.twitter.com/qaIe6jSMjy

— Tetsu (@wtetsu) June 20, 2019

NLP/CV最先端勉強会 やります。

— uchi_k (@wednesdaymuse) June 21, 2019

nlpaper と cvpaper の合同チームでやったグラフと対話応答のサーベイと、CVPR2019速報です。

よろしくお願いします・・・!https://t.co/JPf4fm03t5

【CVPR 2019 速報】を更新しました。230ページの内容になりました!https://t.co/laQX5xGC5p

— cvpaper.challenge (@CVpaperChalleng) June 21, 2019

CVPR 2019 論文サマリはこちらをご覧ください https://t.co/IgsfU8vP37#cvpr2019

弊社匿名希望なエンジニアの最近の深層学習ベースの物体検出のお気持ちがとてもわかる俯瞰的な資料です! / 最近の物体検出 2019/05/30 https://t.co/ikEw7kxu8R

— Yusuke Uchida (@yu4u) June 17, 2019

Best paperたち pic.twitter.com/JNVSHu1x48

— Takanori Ogata (@conta_) June 18, 2019

超解像の未来はどうなる?2019年のサマリ論文を追ってみた

— AI-SCHOLAR. (@ai_scholar) June 14, 2019

https://t.co/QjovShUDH9

帰宅中に読んでいます

— sumicco (@sumicco_cv) June 10, 2019

「実践カメラキャリブレーション ~カメラを用いた実世界計測の基礎と応用~」https://t.co/ErSIHz8s2p

カメラキャリブレーションはとても大事。

Doog

— 森山和道/ライター、書評屋 (@kmoriyama) June 13, 2019

RT

茨城)導入進む農業用ロボット 茨城町のキャベツ生産者:朝日新聞デジタル https://t.co/upKZHMEtv2

農業ロボット関係

choreonoidの便利ライブラリ [C++] on @Qiita https://t.co/WzKDrbYzy0

— wukun (@wukunn) June 12, 2019

Choreonid関係

DJI、“地上を走る”戦車型教育用ロボ「RoboMaster S1」。対戦プレイも - AV Watch https://t.co/qTUQhFcEoZ どろーんもそうだけど、近所の公園で遊べるなら欲しいけどなあ

— 安倍吉俊 (@abfly) June 12, 2019

戦車型なのが日本での教育に向いてない。実銃やレーザーに置き換えるも簡単だろうから怖いし。

【研究紹介】DeepHolo(2017)

— Digital Nature Group (@labDNG) June 10, 2019

ホログラムと機械学習を融合した新たな三次元物体認識手法

点群モデルから再構成した2値加重計算機ホログラム(CGH)を用いたDeepHoloネットワークを提案します。

Project URL:https://t.co/HytDHUtngy

よくわかんないけど。

I just added Fast Winding Numbers for triangle soups to our open source library libigl.

— Alec Jacobson (@_AlecJacobson) June 10, 2019

This optimized implementation can conduct robust inside-outside tests for 1,000,000 points in less than a second on my laptop.

igl::fast_winding_numberhttps://t.co/1KB8GQTxK0 pic.twitter.com/RNdXJjUP5R

カーネギーメロン大学、1台の頭部装着型カメラからの一人称視点映像を入力に自身の3D姿勢をリアルタイムに推定する手法を発表。将来の動きも予測 https://t.co/W4NHHZERhD pic.twitter.com/JADQyXr48V

— Seamless (@shiropen2) June 10, 2019

memo コンピュータビジョンの最新論文調査 3D Vision編 - Technology of DeNA https://t.co/A6EUHTpDUt

— Daito Manabe (@daitomanabe) June 8, 2019

はてなブログに投稿しました #はてなブログ

— しゅんとく (@syuntoku14) September 23, 2018

Fusion360からURDFを一撃で生成するスクリプトを書いた話 - syuntoku14の進捗https://t.co/ysQnz61fIA

MobileyeのCEOのProf.Amnon ShashuaのMVAでのinvited talkがYoutubeに上がっていました.20分過ぎたあたりからと40分あたりからが面白いです.https://t.co/XTON3Uo22o

— Rei Kawakami (@viaminicab) June 7, 2019

点群×ディープラーニング【入門】 | Qiitahttps://t.co/ZITujb0zLz

— ゆるふわUnaさん (@UnaNancyOwen) June 5, 2019

最近の姿勢推定モデルを解説してみた(Cascaded Pyramid Network) | Qiitahttps://t.co/ZhVxqikmaz

— ゆるふわUnaさん (@UnaNancyOwen) June 5, 2019

RT

— 森山和道/ライター、書評屋 (@kmoriyama) June 4, 2019

もうすぐ人間の仕事を奪う? ロボットが1日2万5000個のラズベリーを収穫|BUSINESS INSIDER https://t.co/XzFdPpCGYr @BIJapanさんから

choreonoid v1.7.0のdockerイメージを作ってみた on @Qiita https://t.co/SktvEnYyc6

— wukun (@wukunn) June 3, 2019

生成されたオプティカルフローに基づき、ピクセルを伝播し欠落ピクセルを補完していくビデオ修復法。 https://t.co/J9EnJ04k8p

— AI-SCHOLAR. (@ai_scholar) June 3, 2019

— phalanx (@ZFPhalanx) June 3, 2019

ありがたや...

— Namihei Adachi (@7oei) June 3, 2019

ICRA 2019 速報 by @HirokatuKataoka #computervision #deeplearning https://t.co/qNR8QNOrYp @SlideShareさんから

ソフバンが誤差数cmの測位サービスと低価格GNSS受信機を発表、7月から実証実験開始 – TechCrunch Japan https://t.co/pH00rCvRYN

— 単身赴任おじさん⛅ (@Quodimponeret) June 3, 2019

この間ドコモが同じようなサービス開始とのニュースがあったが、ソフトバンクもネットワーク型RTKのサービスを始めるようだ。

低価格ってどのくらいなんですかね?AI Feynmanは様々な現象を支配する物理法則(ケプラーの法則等)を観測データのみから推定するシンボル回帰問題で、両辺の単位が一致、低次、対称性があるといった事前知識とNNによるblackbox回帰を活用した探索で簡単な公式は100%、難しい公式は90%、推定することができた https://t.co/q6oGiuQND1

— Daisuke Okanohara (@hillbig) June 4, 2019

深層学習は最適化問題を解き学習を達成するが、従来の最適化の「最小解を高速に探索する」という観点では汎化現象を説明できず、最適化の軌跡の理解が重要となっている。学習過程では簡単なモデルから順に学習されていることが予想されている(例 https://t.co/J9B5nVP5eV) https://t.co/V1uuwXySdH

— Daisuke Okanohara (@hillbig) June 4, 2019Google、複数音から特定の発話者だけの声を聞こえるようにするDeep learningを用いた視聴覚音声分離モデル発表https://t.co/IwZxr5xvml

— 宮島正 (@yasuokajihei) June 13, 2019新型LeapMotion 「Rigel」について連ツイします.

— だぶ@技術書典7 せ39D (@troll01234) June 3, 2019

既知の情報が多いと思うけれども.

新しい情報がなかなか出てこない新型LeapMotionErno Horvath and Csaba Hajdu released a simple tutorial shows how to read LIDAR (range) measurements from a file and convert it to occupancy grid. #robot #AI #python PythonRobotics/Mapping/lidar_to_grid_map· AtsushiSakai/PythonRobotics https://t.co/WKR4XcgBtA pic.twitter.com/AKYxieTOuD

— Atsushi Sakai (@Atsushi_twi) June 3, 2019Realtime volumetric capturing with a RealSense T265/D415 combo. It works like a free-floating camera in a 3D scene. Previously I used my hand to "mount" them. Now it's stable and easy to move around. https://t.co/M8O67naCqW pic.twitter.com/raVxCiaKPS

— Keijiro Takahashi (@_kzr) May 30, 2019NVIDIA Jetson Nanoで OpenPoseをビルドする方法、動画から人体の骨格検出 (NVIDIA Jetson Nanoの CUDAパワーで OpenPoseを使って動画から人体の骨格検出)

でべ on Twitter: "レビュー記事書きました!Jetson Nanoですが、ラズパイも少しフォローしてます。 Jetson Nano でカルマンフィルタ不要の9軸フュージョンセンサ BOSCH BNO055を使う https://t.co/6J658G3E1p"

I think the @nvidia Jetson Nano will be a game changer for interactive media art — so I put together a tutorial for getting @openframeworks running on it (including my go-to addons, like ofxKinect and ofxKinectV2) https://t.co/o7OPkx3Ucr #openframeworks #addon #creativecoding

— Madeline Gannon (@madelinegannon) June 13, 2019

Jetson Nanoを使ったアプリケーションが

— Hatenaブログに移行したよ (@Vengineer) June 30, 2019

github(NVIDIAのAI-IOT)にて公開されています。

JeTracer : https://t.co/HzbH8pE6sE

JetBot : https://t.co/bZCUmht6Gq

JetCam : https://t.co/KWirx0MSln

JetCard : https://t.co/KYHbFKEu13JetsonNano関係

"2.5D Printing: Bridging the Gap Between 2D and 3D Applications"を周りに広めようと、雑訳作業をしてる。「違う言葉に置き換える」作業である翻訳、それをスラスラできる人たちって凄いと思う。https://t.co/CeI8xD4zCg

— Jun Hirabayashi (平林 純) (@hirax) June 1, 2019

翻訳を期待!Dynamic Traffic Scene Classification with Space-Time Coherence. https://t.co/3mrWi206ca pic.twitter.com/q2zLP4sBMd

— arxiv (@arxiv_org) June 1, 2019こりゃあ良い記事 BNO055 フィルタ無くても良いらしい9軸IMUの弱点について https://t.co/Tp3n0uLS2H

— でべ (@devemin) June 1, 2019

BNO055では何も考えずQuaternion出力を使え、という話。久しぶりに書いた.

— 床井浩平 (@tokoik) June 1, 2019

床井研究室 - Oculus Rift に図形を表示するプログラムを C++ で作るhttps://t.co/lUnY8kaAZ3

書きたいことは他にもあるけど時間がなぁ…

大事だと思うんです。Unityでオブジェクト置いたら終わり、じゃ意味ないもん。A survey of Object Classification and Detection based on 2D/3D data. https://t.co/eMnNCHdRSX pic.twitter.com/7IiUrvIBuQ

— arxiv (@arxiv_org) June 1, 2019todaitotexas.com

欲しい情報が何一つ手に入らない素敵なWEBページ。光が漏れる光ファイバー。ELファイバーと違い漏電しないので水辺でも使える。 pic.twitter.com/gj0lNgnBKh

— ミクミンP/Kazuhiro Sasao (@ksasao) June 1, 2019

展示内容は素晴らしい。

Jetson Nanoをロボットに搭載するために、リチウムポリマー6S22.2Vから5V80Wを安全に取り出せる電源を作る

Jetson Nanoは、安くて早くて便利ですが、フルスピードで動かそうとすると20Wの5V電源が必要になります。一般に、これをUSB電源からとるのは無理なので、DCDCコンバータを用意する必要があります。

一方、ロボットではモータを駆動するために、+12Vや+24Vの電源が使われることが多いです。そこで、24Vから5Vを作る電源を検討したいと思います。

この記事を参考にして事故等が起きても一切の責任を取れません。よくご検討の上自己責任でお願いいたします。

DCDCコンバータの選定

ロボットに搭載するために、できるだけ回路は物理的に小さくしたいと思います。自作でDCDCコンバータを作るとどうしても大きくなってしまいますから、素直にメーカー品を選定することにします。

www.cosel.co.jp

www.cosel.co.jp

有名メーカーのモジュールを探したところ、COSEL MGFS40/80シリーズが出力/サイズ比がもっともよさそうです。値段もそれぞれ、4000円、7000円とリーズナブルです。それぞれ、2台、4台のフルスペックJetson Nanoを動かすことができます。

難点は、現時点でどちらも在庫薄であることですが、そのうち入荷するでしょう。

低電圧検出回路の設計

大本の電源をリチウムポリマー電池から取り出すことに注意しなければなりません。リチウムポリマー電池は、過放電すると単に使えなくなるばかりか、膨らんで爆発するなどの危険性があります。そこで、終止電圧が来たらDCDCコンバータを自動的に止めるようにしなければなりません。リチウムポリマーの1セルの基準電圧は3.7V、終止電圧は3.0Vぐらいが一般的です。厳密にやるならば、各セルの電圧を監視するべきなのですが、回路規模的に大変になってしまうので、6S18Vを終止電圧としてDCDCコンバータを止めるようにしたいと思います。

ツェナーダイオードを使って基準電圧を作ります。18Vを直接比較しようとすると、もっと大きな電圧が比較回路のために必要になってしまいますので、5V程度の電源で駆動できるように適当に電圧を調整します。また、電圧を比較するのに最も手軽な方法は、OPアンプをコンパレータとして使うことだと思います。OPアンプの+入力にツェナーダイオード、-入力に抵抗で分圧したバッテリー電源電圧を入れます。

回路の原理確認には、このWEBアプレットの回路シミュレータを使いました。電源電圧が18Vを超えるとコンパレータの出力はLowになり、18Vを切るとHighの+5Vを出力します。

部品は、手元にあった3.6Vのツェナーダイオードを使うことにします。またコンパレータには、手元に転がっていた単電源OPアンプのJRC 3414ADを使うことにしました。これは、バイポーラ型ですが消費電力の少ないFET入力の方が良いと思います。

抵抗の分圧比は、電源電圧が18Vの時に3.6Vの電圧が下の抵抗にかかるように調整します。系列の抵抗値に当てはめて、下を3.6kΩ、上を14.4k(12k+2.4k)にしました。ノイズを恐れて多めに電流を流すようにしましたが、もうちょっと少なくてもいいかもしれません。

単電源OPアンプの電源を用意するのが億劫ですが、強い味方のスーパー三端子レギュレータ+5Vが手元にあったのでこれを使うことにします。超便利なので、手元にいくつか在庫を用意しておくと良いです。

ただし、こいつは低電圧検出後も停止されず微弱ながら電流を引き続けますので、停止してしまったら速やかにバッテリーを取り外す必要があります。基準電圧用のツェナーダイオードの電源とOPアンプの電源は同じものを用いてください。

akizukidenshi.com

あとは、このコンパレータの出力電圧をCOSELのDCDCコンバータのRC端子につないでやれば良いです。

注意点として、本来は出力にヒステリシスを入れて、一度基準電圧を切ったらラッチさせてチャタリングが起きないようにするべきだと思います。クリティカルな用途に使う際はよく注意してください。

出力状態の監視出力

この5V用DCDCコンバータで低電圧検出回路が働いたら、(もし使っていれば)他の系統の電源も連携して停止するようにするべきです。出力側の5Vの電圧でフォトカプラを駆動して、入力側の電圧基準で信号を取り出せるようにしたいと思います。

フォトカプラには、京都のマルツで入手できた東芝TLP550を使うことにします。これは、何の変哲もないオープンコレクタ出力1回路の物です。

toshiba.semicon-storage.com

メインのDCDCコンバータ電源回路

COSELのデータシートに従って素直に作ります。コンデンサのESRが無いので、シミュレータはこのままでは動きません。

実装

出来ました。

今日の本文

ダイエットのために、病院でおすすめされました。

イージーファイバー お通じの改善に役立つ食物繊維 30パック【特定保健用食品】

- 出版社/メーカー: 小林製薬

- 発売日: 2014/04/05

- メディア: ヘルスケア&ケア用品

- この商品を含むブログを見る

大塚製薬 賢者の食卓 ダブルサポート (6g×30包)×10箱【特定保健用食品】

- 出版社/メーカー: 大塚製薬

- メディア: ヘルスケア&ケア用品

- この商品を含むブログを見る

ソニーのMDR-M1STが届いたので開封の儀

長年愛用してきたMDR-CD900STの後継機とも言われているMDR-M1STが発売されたので買ってみました。

早速届いたので、開封の儀。

感想

第一インプレッションは、CD900STとの細かい違いが気に入らなすぎて不満。

ヘッドバンドのクッションは薄い方が良いし、押しつけ圧が強くて長く使えないのも不満。

音質もCD900STと違うことが不満。

Final D8000と比べてしまうのが悪いのは分かっているけれど、今時のいい音とはかけ離れているし。これが標準の音になってしまったら悲しい。

LookingGlassでの表示を綺麗にするために、three.jsのdisplacement mapの階調を8ビット256から24ビット16777216に拡張する

displacement mapは、画像データを元にお手軽に3次元(2.5次元)形状を表現する手法として知られています。これを使ってLookingGlassの表示アプリを作っている方がいたりして、なるほど簡単で良いなと感心しました。

stereo.jpn.org

ただグレーは通常256階調しか持ちませんので、Looking Glassの奥行表現の性能を表現しきれません。そこで、256階調を3色分の情報を使ってもっと細かに奥行を表現できるようにしたいと思います。

var displacementmap_vertexを改造する

three.jsではdisplacement mapをvar displacementmap_vertexという変数の中に定義した式で計算しています。そこで、この式の記述を探して中を書き換えてしまいます。

デフォルトのグレー256階調をコメントアウトします。

//var displacementmap_vertex = "#ifdef USE_DISPLACEMENTMAP\n\ttransformed += normalize( objectNormal ) * ( texture2D( displacementMap, uv ).x * displacementScale + displacementBias );\n#endif";

その下に、3色1677階調版を記述します。チャンネル毎に256倍のオフセットを与えているだけです。

var displacementmap_vertex = "#ifdef USE_DISPLACEMENTMAP\n\ttransformed += normalize( objectNormal ) * ( (texture2D( displacementMap, uv ).x + 256. * texture2D( displacementMap, uv ).y + 256. * 256. * texture2D( displacementMap, uv ).z ) * displacementScale + displacementBias );\n#endif";

データは、手前から奥へRGBの並びになります。

今日の本文

ソニーのモニターヘッドホンのMDR-M1STが出たので買ってみましたが、圧がCD900STより強くて長時間使えません。なんでこんな変更をしたんだ?

ソニー・ミュージックソリューションズ ハイレゾ対応スタジオ用モニターヘッドホンSONY MDR-M1ST

- 出版社/メーカー: Sony

- メディア: エレクトロニクス

- この商品を含むブログを見る

SONY 密閉型スタジオモニターヘッドホン MDR-CD900ST

- 出版社/メーカー: ソニー(SONY)

- メディア: エレクトロニクス

- 購入: 10人 クリック: 273回

- この商品を含むブログ (53件) を見る

final D8000 FI-D8PAL 平面磁界型ヘッドホン

- 出版社/メーカー: final

- メディア: エレクトロニクス

- この商品を含むブログを見る

Jetson NanoでRealSense D435iとT265を使ったプログラムを自動起動させる方法

Jetson Nanoは値段が安くてそこそこ性能が良いので、ロボットの頭として便利に使えます。画像処理も得意なのでいろいろなセンサーを搭載して、ロボットの起動と同時に、それらセンサーを使ったプログラムが自動で起動するようにしたいことが結構あります。

「Ubuntu」「自動起動」などで検索してやり方を調べてみると、rc.localを使った方法やsystemdを使った方法などが見つかります。しかし、これらはX-Windowが立ち上がる前に呼ばれてしまうので、X-Windowを使用するプログラムを正しく起動することが難しいです。

またteratermなどからログインしてプログラムを起動しようとしても、xwindowを使うプログラムは画面のポートフォワーディングを設定しておかないとすんなり立ち上がってくれません。

そこで、xwindowが立ち上がってからプログラムを起動するように設定したいと思います。

~/.config/autostartを使う

Gnomeデスクトップの準備ができてからプログラムを起動するためには、ユーザのホームディレクトリに隠されている.configディレクトリの下に、autostartというディレクトリを用意して、その中に.desktop拡張子をもったファイルを置くことで行います[1]。

準備

autostartディレクトリが無い場合は自分で作ります。

> cd ~/.config

> mkdir autostart

> cd autostart

> nano realsense.desktop // なんでもいい適当なファイル名.desktop

realsense.desktopの中身は書式[2]に従って

[Desktop Entry]

Exec=何か実行したいプログラム

Type=Application

と書きます。

実行失敗したときにエラーメッセージが読めないと困るので、gnome-terminalを立ち上げてから、起動用のシェルプログラムを呼びます。

[Desktop Entry]

Exec=gnome-terminal -- bash -c "bash /home/cvl/workspace/openFrameworks/apps/myApps/myRealsenseMulti/autostart.sh; bash"

Type=Application

プログラムが終了したときに窓が消えてしまわないように、;bashを最後におまじない的に入れておきます。

autostart.shの中身は好きに書いてもらえばいいのですが、こんな感じで使っています。

sleep 5;

cd ~/workspace/openFrameworks/apps/myApps/myRealsenseMulti

make RunRelease

スーパーユーザー権限が必要な時の対処法

Dynamixelのモータとか、ルート権限が必要なデバイスを起動したいときはsudoを付けて起動しますが、通常パスワードをインタラクティブに入力しなければなりません。sudoに-Sオプションを付けると、標準入力からパスワードを読んでくれるようになりますのでこれを利用します。

autostart.shをこんな感じに変えます。

PASSWORD=password

echo PASSWORD | sudo -S ./bulk_read_write

参考文献

[1] Ubuntu起動と同時に自動でターミナルを開く - Qiita

[2] Autostart - LXDE.org

今日の本文

Jetson Nanoは本体は安いけれど、オプションに結構お金がかかるのが難点です。自分が使っているものを備忘録として、記載しておきます。

NVIDIA Jetson Nano開発者キットケース用の新しい到着アクリルケースボックス(ジャストボックス)

- 出版社/メーカー: heartbeeps

- メディア: エレクトロニクス

- この商品を含むブログを見る

Noctua NF-A4x20 5V PWM 40mm 静音 ファン 5000rpm

- 出版社/メーカー: Noctua

- メディア: Personal Computers

- この商品を含むブログを見る

- メディア:

- この商品を含むブログを見る

SUCCUL ACアダプター 5V 4A 大手メーカーOEM社製品 センタープラス スイッチング式 最大出力20W 出力プラグ外径5.5mm(内径2.1mm)PSE取得品

- 出版社/メーカー: サクル株式会社

- メディア: エレクトロニクス

- この商品を含むブログを見る

- 出版社/メーカー: Hommy

- メディア:

- この商品を含むブログを見る

![microSDXC 128GB SanDisk サンディスク Extreme UHS-1 U3 V30 4K Ultra HD A2対応 SDアダプター付 [並行輸入品] microSDXC 128GB SanDisk サンディスク Extreme UHS-1 U3 V30 4K Ultra HD A2対応 SDアダプター付 [並行輸入品]](https://images-fe.ssl-images-amazon.com/images/I/41r5qp7ERJL._SL160_.jpg)

microSDXC 128GB SanDisk サンディスク Extreme UHS-1 U3 V30 4K Ultra HD A2対応 SDアダプター付 [並行輸入品]

- 出版社/メーカー: サンディスク

- メディア: エレクトロニクス

- この商品を含むブログを見る

高性能3dBi 2.4GHz/5GHz 無線LANカード WIFI/Wimax/Bluetoothモジュール用アンテナ 2本セット (MHF4 Cable=240mm)

- 出版社/メーカー: LTDparts

- メディア: エレクトロニクス

- この商品を含むブログを見る

ファンの取り付けのために、3mmのタップが立てられると便利です。

- 出版社/メーカー: ライト精機

- メディア: Tools & Hardware

- この商品を含むブログを見る

自分用読むべき論文メモ 2019年5月版

5月は情報多すぎて、上手く咀嚼ができてない.

Disney Researchなど、リアルな眼の動きを再現するために眼球運動の構造を理解しモデル化する手法を発表 https://t.co/EM9A1BO499 Movie credit: DisneyResearch|Studios pic.twitter.com/yCSvN0XtwJ

— Seamless (@shiropen2) May 31, 2019

眼球運動

QiitaではTW2710推しが目立つが

— Reyes (@shirokunet) May 31, 2019

いつも悩むGPSアンテナの選択

ケンブリッジ大学が着て洗える“電池”を開発!布に織込む導電インク - Techable https://t.co/ovWTcgyuBM pic.twitter.com/ubOznbmau5

— beep_R_A.K. (@beep_roadrunner) May 30, 2019

洗える電池

いやーNuraのヘッドフォンほんとヤバいわ。要は使用者の耳に合わせてキャリブレーションして色つけてるんだけど、本当にいい席にいるように聞こえるライブ盤と、完全に音源として再構成してるライブ盤の違いがなんとなくわかる。耳いい奴ってこんな聞こえ方してんのか。 https://t.co/eHBrxcREE2

— Mill Yoshi (@ntheweird) May 28, 2019

欲しい。

5/31-6/1にある生研公開で佐藤菅野研の公開で菅野先生らが開発したOpenGazeのデモします!! pic.twitter.com/IcsOJhoHE8

— けいひぐ (@keihigu) May 29, 2019

視線推定。Jetson Nanoでは重かった。

PMSM基本的なチャート

— Nakamura(yutaka) (@ioloa_N) May 27, 2019

①3相120度ずらしたPWMを入力して回す

②3相・単相変換したdq軸モデルで回す

③電流フィードバックしてベクトル制御

④数式モデルセンサレス・簡易ベクトル制御

⑤オブザーバセンサレス

⑥拡張誘起電圧オブザーバ

(⑦PWMタイマ自作→0速度センサレス)

⑧適応制御オブザーバ

モータノウハウ

ArxivのDeep Learning関連論文を被引用数順に1000本並べてみる - https://t.co/7ogPISSZkC

— Qiita_Python (@qiita_python) May 27, 2019

Asusから240Hzのポータブルモニター。これで超高リフレッシュレートの映像をいろいろ実験したら楽しそうだ… https://t.co/4TFniIcH7y

— 田所 淳 (@tadokoro) May 28, 2019

240Hzは要らない。欲しいのはHDMI入力なのでMB16AMTで良い。早く出ろ。

さて本日は、MATLAB EXPOでポスター展示

— leftbank (@cafe_on_the) May 27, 2019

「単眼立体視の原理と現代制御理論を応用した空間音響再現」

新たな原理で、広い音場と明確な定位が得られる高音質な3D音響再現を可能としました

一人なので休憩でいないこともあるかもしれませんが、すぐ戻ってきます

多分(¬_¬)

https://t.co/E66CvpTVBn

高音質な3D音響レンダリング。気になる。

こちらの記事のパッチを使わせてもらって、Jetson Nanoで無事にIntel Realsense D435i が使えるようになった!ちゃんとIMUのジャイロと加速度も出た~。パッチの中身読んだけど、この記事の人すごいなぁ。https://t.co/DSFDdYLIrJ pic.twitter.com/SaWFOcrRXJ

— でべ (@devemin) May 27, 2019

Jetson NanoでRealsense D435i

置いておきますねhttps://t.co/hBkYlbLtEu

— 中村 薫(Kaoru Nakamura) (@kaorun55) May 27, 2019

Git

殺伐としたディープラーニングネタですが、フリー素材でほっこりして下さい / 2件のコメント https://t.co/s1biGZwxMZ “TensorFlowの物体検出用ライブラリ「Object Detection API」を手軽に使えるソフト「Object Detection Tools」を作ってみた - karaage. [からあげ]” https://t.co/p1PG8NnQTR

— からあげ (@karaage0703) May 27, 2019

ロボティクス分野の国際会議、モントリオール開催のICRA 2019の報告資料を作成させて頂きました! #ICRA2019 https://t.co/LgtPjqQVZc

— 片岡裕雄 (@HirokatuKataoka) May 25, 2019

ICRA2019

コレは凄い!https://t.co/KKCAR0jlwb

— PINTO0309 (@PINTO03091) May 24, 2019

高解像度化

torchvision 0.3.0: segmentation, detection models, new datasets, C++/CUDA operators

— PyTorch (@PyTorch) May 23, 2019

Blog with link to tutorial, release notes: https://t.co/7PuNpMrL58

Install commands have changed, use the selector on https://t.co/DeaBDSRxs8 pic.twitter.com/Ljt7rSymno

CVPR 2019 Open Access Repository

— 望月紅葉さんと幸せな家庭を築きたい (@momiji_fullmoon) May 24, 2019

公開されてる💪 https://t.co/luCunCssks

CVPR2019

これは使ってみたくなるかも。 https://t.co/CAy4PX9kKW

— Jun Hirabayashi (平林 純) (@hirax) May 23, 2019

数式エンジンのAPI

300個以上の高精細なアノテーション付き3Dモデル,セマンティックセグメンテーション用の画像データセットです!ダウンロードはこちらから!https://t.co/3Olh5LGYnA https://t.co/f2rdhRT3Kn

— S.Akizuki (@spark25_307) May 24, 2019

www.chukyo-u.ac.jp

アノテーション付き3Dモデル

面白い

— 尹 祐根(ゆん うぐん) (@WooKeunYOON) May 24, 2019

「自分の身体に気づくための二つの処理過程を発見 リハビリテーションなど身体認知のメカニズム理解へ」 https://t.co/3mJG8qdBcd

木材を化学処理してリグニンを取り除いてから圧縮すると、鉄やチタンと比肩しうる強靭な建材になる、という研究の話。しかも「赤外線を吸収しにくく、しかし放熱性はやたらと高い」みたいな面白い性質も https://t.co/J9ysUP5hFG

— ultraviolet (@raurublock) May 23, 2019

木材ベースの新素材

ICRA2019で東北大 多田隈研究室の新型ドローンメカが見事 Best Paper Award on Mechanisms and Designをゲット!

— Shuuji Kajita (@s_kajita) May 23, 2019

Development and Experimental Validation of Aerial Vehicle with Passive R... https://t.co/DF7IdEmyAt

全てのドローンにあのボールの装着を義務付けてほしい。怖いから。

professor.kanagawa-u.ac.jp

モーターの先生

Software optimization resources https://t.co/RNBxUN4iXX

— きばんちゃん (@kivantium) May 23, 2019

高速化に関するドキュメントについて聞いたらAgner Fog という人のページを読むとよいと言われた

Excited to be at #ICRA2019

— Animesh Garg (@animesh_garg) May 20, 2019

Best Paper Award talk

Making Sense of Vision and Touch: Self-Supervised Learning of Multimodal Representations for Contact-Rich Tasks

Paper: https://t.co/HlzydfoJJ9

Video: https://t.co/dOAUy15Xwa

ICRA2019のベストペーパー

「次世代の半導体素材として注目される炭化ケイ素(SiC)から成る製パワー素子のPCUへの適用だ。800ボルトと高い電圧で駆動できるPCUを開発した」 RT @ フォーミュラE優勝、独ZFの高効率パワートレーン:日本経済新聞 https://t.co/hmYMR42TeE

— y-fullmoon (@hf_and_beyond) May 22, 2019

SiCが活躍し始めた

本家の Arduino Uno とピン互換で値段も同じくらいなのに、液晶モニタ、カメラ、WiFi/Bluetooth(技適マークあり)、マイク、オーディオアンプ がついて、ディープラーニングのアクセラレータもある!どういうことなの.. https://t.co/sQAak3L8Q4

— ミクミンP/Kazuhiro Sasao (@ksasao) May 22, 2019

気になるおもちゃ

文化庁が“文化財の訪日旅行客向け多言語解説”に補助金、VR/ARコンテンツも対象に - Mogura VR News https://t.co/BsifBQ97Qc

— Mogura VR News (@MoguraVR) May 22, 2019

はて。

東工大 奥富・田中研究室と社会知能研究チームの研究グループは、産総研が開発したDhaibaWorksを活用して、大規模なラベル付LiDARデータセットを構築しました。本データセットを訓練用データに利用することにより、3次元データに基づく人検出モデルを構築することができます。https://t.co/SkQD5zvXNC

— 産総研人工知能研究センターAIRC (@AIResearchAIST) May 21, 2019

Lidarデータセット

www.itmedia.co.jp

4脚ロボット

qiita.com

便利そう

角倉君(@sumicco_cv)と渋谷君(@mikiya85)がインターンで取り組んでくれたVisual SLAMフレームワーク" 𝙊𝙥𝙚𝙣𝙑𝙎𝙇𝘼𝙈 "を本日公開しました.透視投影だけでなく,全方位や魚眼にも対応しております.BSDライセンスのため企業の方にもぜひご利用頂ければと思います.https://t.co/fJxfPH1u1N https://t.co/RfXZ7kBYk9

— Ken Sakurada (@sakuDken) May 21, 2019

JetsonNanoでも動くOpenVSLAM

#Unity Shader Programming Vol.02 Lighting/Shading をリリースしました。遅くなりました。理由はいろいろありますが、価格がだいぶ上がってます。サンプルを用意したので確認の上で購入を検討してください。学生の頃に欲しかった、を目安に書いてます。https://t.co/i60OexqPAv pic.twitter.com/DU1O944ufe

— XJINE (@XJINE) May 20, 2019

Unity向けだけど勉強になりそう

ICRA 2019にて「教師なし文脈外行動理解」を発表します!

— cvpaper.challenge (@CVpaperChalleng) May 21, 2019

Hirokatsu Kataoka, Yutaka Satoh, "Unsupervised Out-of-context Action Understanding," IEEE International Conference on Robotics and Automation (ICRA), 2019.

教師無し文脈行動理解

明日の2限に駒場の学術フロンティア講義を担当します。タイトルは「音を解析・合成する信号処理技術」です。講義資料はこちら👉 https://t.co/vOiVxhPg7H

— Shoichi Koyama (@sh01) May 20, 2019

(空間音響チュートリアルっぽくなっています・・・) https://t.co/PyGQzK7JEt

音の解析と合成技術の資料

東大、「充電中に自己修復して長持ちする電池」の原理検証に成功https://t.co/THoHLtXIaj pic.twitter.com/5r3AH07zsK

— ITmedia NEWS (@itmedia_news) May 20, 2019

H∞制御(ロバスト制御)と外乱オブザーバ(外乱ロバスト)の違いがいまいち分からないのでこのあたり読む https://t.co/GJxEgacDOwhttps://t.co/N23TlwDr8Q

— モータ制御マン (@motorcontrolman) May 16, 2019

http://www.dwdrums.com/images/moonmic/olson_direct-radiator-loudspeaker-enclosures.pdf

スピーカーエンクロージャーの特性

shiropen.com

単眼ハンドモーキャプ

時間の都合,講演であまり各論には触れられません.きっかけになったサーベイ資料を公開していますので,併せて活用してもらえればと思います.https://t.co/wDpJHY9SpW

— Naoya Chiba (@n_chiba_) May 14, 2019

もしこのあたりに興味があってお話して頂ける方がいたら,3日間会場にいますので声をかけてもらえると嬉しいです.

点群関係

ETH Zurichなど、外部光学機器を必要とせずにリアルタイムに手のポーズを推定するdeep learningを用いたストレッチセンシングソフトグローブを発表 https://t.co/NvJQfJfI1E pic.twitter.com/bhR8NDk6Kz

— Seamless (@shiropen2) May 14, 2019

グローブ型のハンドモーキャプ

コンピュータビジョンのトップカンファレンスCVPRで、産総研発のビジュアルSLAMの論文が採択されました!

— Shuuji Kajita (@s_kajita) May 13, 2019

VITAMIN-E: VIsual Tracking And MappINg with Extremely Dense Feature Poin... https://t.co/DXJrvDNZW0

阪野さん

www.livoxtech.com

store.dji.com

安いからうっかり買ってしまいそうになる。欲しいけど。画角に注意。

来週の国際会議@ USにて脳細胞の発火リズムついて講演し、「シナプスの数がある程度増えると相転移が起きて細胞たちが同期発火するが、増えるぎると同期が破れてアホになる」ことを"数学的に"証明します。初公開です。下記の池谷先生のツイートに触発されてやりました。 https://t.co/9ydfFDDSfU

— 千葉逸人 (@HayatoChiba) May 14, 2019

勉強しすぎに気を付けよう

UCバークレーなど、スマートフォンで撮影した画像から実世界の3Dシーンをよりリアルに再構築する手法を発表 https://t.co/1IcfIxbCDq pic.twitter.com/r6JG9DcnUo

— Seamless (@shiropen2) May 11, 2019

内容以上に動画がうまい

MPI-IS、音声から顔アニメーションをより自然に生成するdeep learningを用いたフレームワーク「VOCA」を発表 https://t.co/6KpJFOxBA1 動画で声と共に出力結果を確認できます。 pic.twitter.com/1ZNEHTAYdV

— Seamless (@shiropen2) May 10, 2019

TensorFlowでグラフックス関連のパラメーターを推定するためのライブラリTensorFlow Graphicsが公開。3Dモデルの推定などはラベルデータの用意が大変なため、2D=>推定=>レンダリング=>3Dで2D/3Dの一致をとる形で学習が行えると良い。これには微分可能なRendererが必要だが、それを提供してくれている。 https://t.co/c2ah3XA21k

— piqcy (@icoxfog417) May 10, 2019

TensorFlow用微分可能なレンダラー

近日MLPシリーズで刊行予定の「ベイズ深層学習」の目次を貼ります.

— 須山敦志 Suyama Atsushi (@sammy_suyama) May 10, 2019

1章,はじめに

2章,ニューラルネットワークの基礎

3章,ベイズ推論の基礎

4章,近似推論手法

5章,深層学習モデルのためのベイズ推論

6章,深層生成モデルとベイズ推論

7章,深層学習とガウス過程 pic.twitter.com/PuPyAyDux2

買う本

これは凄い。こういう処理を自分で走らせるためだけにでも、早いPCを手に入れるための仕事に出たくなる。

— Jun Hirabayashi (平林 純) (@hirax) May 10, 2019

"Inverse Rendering for Complex Indoor Scenes:

Shape, Spatially-Varying Lighting and SVBRDF from a Single Image"(PDF)https://t.co/1CleHUuARF

PerceptNet: Learning Perceptual Similarity of Haptic Textures in Presence of Unorderable... https://t.co/viD8rNkZjf pic.twitter.com/pVqm8O0Du1

— arxiv (@arxiv_org) May 10, 2019

arxiv.org

触覚

Take a look inside this fully automated 3D-printing facility pic.twitter.com/14bkXIrDD9

— Tech Insider (@techinsider) May 5, 2019

ずっと見てたい

点群における3Dターゲット検出の新しいフレームワークVoteNet、2つのデータセットで最高精度を更新|https://t.co/UoV8p66spR https://t.co/1r2HjCwbwg

— Naoya Chiba (@n_chiba_) 2019年5月7日

PointNet著者らの新しい論文の紹介記事.大学ミスってたりとか気になる部分もあるけど,ともかく公開から二週間ちょいでの紹介は仕事が速くてすごい

ai-scholar.tech

これから弊研の勉強会スライドあげていきますので

— Mendy Sekiguchi (@ShunichiSekigu1) May 6, 2019

もしモデルベース強化学習に興味のある方がいれば、ぜひみていただいてコメントをいただけると嬉しいです!https://t.co/WJ9mjBX1NX

モデルベース強化学習まとめ。ありがたい。

CVPR'19論文。滑らかで閉じた3Dメッシュを生成するためにグリッド上での占有確率をDNNで出力し、それを使ってMarching Cubeでオクツリー分割していく過程ごと機械学習。非常に綺麗な結果。"Occupancy Networks: Learning 3D Reconstruction in Function Space https://t.co/oq5kjDVmNK

— Yamo (@yamo_o) May 8, 2019

github.com

綺麗に立体復元

機械学習による光源推定の機能強化はTensorFlow-liteのニューラルネットを使っているとのことで、どのような学習用の画像を用意した等の詳細はこの論文にあるそうです。 #ARCore #io19jp https://t.co/OgmXvxw0tA

— Kenichi Takahashi (@ken1_taka) 2019年5月7日

arxiv.org

光源推定

www.digikey.jp

150A10VでRds_onが0.75mΩとかいつの間にかすごい時代になったなぁ

ABC: A Big CAD Model Dataset For Geometric Deep Learning

— hardmaru (@hardmaru) 2019年5月8日

A collection of a million computer-aided design (CAD) models. Will be fun to play with vector design plans. Hope they included the kitchen sink! 🚰https://t.co/d6JmHcJbkghttps://t.co/uCe3XR978mhttps://t.co/Q3BGKqZmmz pic.twitter.com/ROfu4NC0md

CADモデルデータセット

物理学の系でDNNを使うのは最近盛んです.例えば: https://t.co/WW7uRibjbC しかし,これは基本的に対象系の時間スケールにおいてPDEや流体方程式などの時間発展方程式を立てられるという前提条件があって,時間発展方程式を解くのが難しいのでその簡便法としてDNNが利用できないか,というものです.

— Yuta Kashino (@yutakashino) 2019年5月7日

大口径BLDCを使ったバックドライバブルなオープンソースアクチュエータ

— ぷらぎあ (@plastic_gear) April 22, 2019

理論トルク80N•m

ODriveで位置制御やトルク制御も可能https://t.co/6lq6A9qmAq

モーターを作ろう

AutoEncoder(AE)はデータから圧縮された表現を学習する際に頻繁に用いられるが、2つのデータの組み合わせから“補間“できる点に着目した研究。補間表現から混合割合を復元するよう学習されたネットワークに対してAdv trainingの枠組みを導入し、よりリアルな生成を行う正則化手法を提案 https://t.co/1CFJ0zN1U8

— しゅんけー (@shunk031) 2019年5月5日

『システム/制御/情報』のガウス過程特集号「ガウス過程回帰の基礎から応用」が,先月から無料で読めるようになってる!https://t.co/39JMQCFo7m pic.twitter.com/OLQUJHVBZR

— ササキ (@saitosasaki) 2019年5月5日

東工大の @hasevr 先生による触覚学の講義資料、とてもよくまとまっていて良い https://t.co/MslFH1QY2Q

— 稲見昌彦⛅INAMI Masahiko (@drinami) May 3, 2019

リンク先の資料が勉強になる。

synapse.kyoto

知っとく価値がある。

nVidiaのJetson nanoで、ホログラムディスプレイのLookingGlassをHoloPlay.jsのSDKで使えるようにする。

Looking Glassは超面白いですね。今まで、さんざん色々な3Dディスプレイの表示クオリティの低さにがっかりさせられてきましたが、Looking Glassの画質はかなりいい線まで来ているように思えます。(欲を出せばいろいろありますが。)

Looking Glassにリアルタイムで描画しようと思ったら、3Dモデルを40枚同時に描画できなければいけないので、PCの要求仕様がかなり高いことが難点です。とくにそれらの値段が高く大きく重いことが悩みになります。

ところが、折しもちょうどいいタイミングでnVidiaのJetson Nanoという高度な描画能力を持ったマイコンボードが1万3千円ぐらいで買えるようになっていますので、この2つを組み合わせれば理想的じゃないか、と誰もが思いつくと思います。今日は、これをやってみたいと思います。

1.Jetson Nanoの準備

Jetson Nanoのイメージの焼きこみなどは、こちらを参考にしてください。

developer.nvidia.com

ぐぐれば一杯情報が出てきます。まっさらにインストールした状態から始めることにします。

2.準備

まず、作業用のディレクトリを作ります。

> mkdir workspace

> cd workspace

> mkdir ThreeJSTutorial

> cd ThreeJSTutorial

> mkdir js

次に、three.jsライブラリとHoloPlay.jsライブラリをダウンロードして展開します。

GettingStartGuideを見ながら進めるといいでしょう。

docs.lookingglassfactory.com

読むのが面倒くさい人は、次のリンクから。

https://github.com/mrdoob/three.js/archive/master.zip

https://s3.amazonaws.com/static-files.lookingglassfactory.com/ThreeJSLibrary/v0.2.1/HoloPlay.zip

これらのZIPを展開して、中身を~/workspace/ThreeJSTutorial/jsの下にコピーします。必要なのは.jsファイルが二つだけですが面倒くさいので全部コピーでも動きます。(WEBを公開する予定があって、セキュリティ等が気になる人は必要なファイルだけの方が無難。)

テスト用のindex.htmlを作ります。

まっさらの状態のJetson Nanoですとまだ使いやすいエディタも入っていないので適当なものを入れます。

sudo apt-get update

sudo apt-get -y install nano

Getting StartのWEBページの一番最後にあるexampleのソースコードをコピーして、index.htmlファイルを作ります。

> nano index.html

コピペ

medium.com

こちらのページにも同様のexampleが載っていますが、こちらの方は時間ごとに更新されて動くのでアニメーションさせたいときの参考になります。

3.WEBサーバのインストール

WindowsやLinux向けのWEBサーバーインストーラアプリXAMPPは、x86/x64をターゲットにしたバイナリで配布されているので、ARMコアのJetsonNanoでは動きません。要はLAMPのアプリが入っていればいいので、手動でインストールしていきます。Lampのインストール方法は、Jetson向けの物はほとんど見つかりませんが、RaspberryPi用の記事はたくさん書かれていますのでこれを参考にします。

www.neko.ne.jp

インストールコマンドだけを抜き出すと、こんな感じになります。sudoで始まる行だけ辿れば大丈夫のはず、です。

> uname -a

> perl -V

> sudo apt-get udpate

> sudo apt-get -y install apache2

> apache -V

> sudo apt-get -y install php php-dev php-fpm php-gd

> sudo apt-get -y install php-mysql

> sudo a2enmod proxy_fcgi setenvif

> sudo a2enconf php7.2-fpm

> sudo systemctl reload apache2

php7.2-fpmの7.2はphpのバージョンに対応します。適切なバージョンを入れてください。

> sudo apt-get -y install mysql-server

> mysqld -V

> mysql -V

> sudo apt-get -y install phpmyadmin

[yes]

[password] x2

[apache2]

4.WEBコンテンツのパスを通す

apache2のdefaultのWEBコンテンツの置き場所は、/var/www/html/の下です。状況が変わって見つからないときは、

> sudo find / -name index.html -print

などで探すとよいでしょう。ここに、workspaceディレクトリの下に作ったThreeJSTutorialディレクトリのシンボリックリンクを張ります。

> cd /var/www/html

> sudo ln -s ~/workspace/ThreeJSTutorial ThreeJSTutorial

> cd

5.Holoplay.js for Linuxを起動する

何の制限があってかわかりませんが、LookingGlassのThree.jsライブラリであるHoloPlay.jsはWindowsとMacにしか正式に対応していません。これを何とかするライブラリを先人が開発してくれているので、これを使いわせてもらいます。一応、アンオフィシャルだと思うので何があっても自己責任でお願いします。

github.com

初出はこちら。

Holoplay.js for Linux - Made with Looking Glass - Looking Glass Factory Forum

Githubからソースコードをダウンロードしてきて解凍します。適当な場所においてもかまわないはずなのですが、なぜかapt-getでgolang goをインストールしようとすると~/goにGOPATHを通そうとする(そして.bashrcに別の場所を書いても無視される)などのよくわからない挙動をしめす「ことがある」ので、~/goに展開してしまいます。

golangをインストール

> sudo apt-get -y install golang-go

> nano ~/.bashrc

一番最後の行に、

export GOPATH=~/go

export GOBIN=$GOPATH/bin

export PATH=$GOPATH/bin:$PATH

を足す。

> bash

golangのパスの機嫌がよくわからないときがあるので、何か困ったらWEBでもっと詳しいページを調べてください。

次にgoの実行環境を整えます。

> cd ~/go

> go get

何も言われず終了すればうまくいっているようです。何か文句を言われたら、PATHの設定などが間違えているのかもしれません。

これで準備ができましたので、goスクリプトを実行します。

> sudo go run main.go

この時点では何の応答もありません。

LookingGlassのUSBを接続して、WEBブラウザで用意したThreeJSTutorialを開きます。

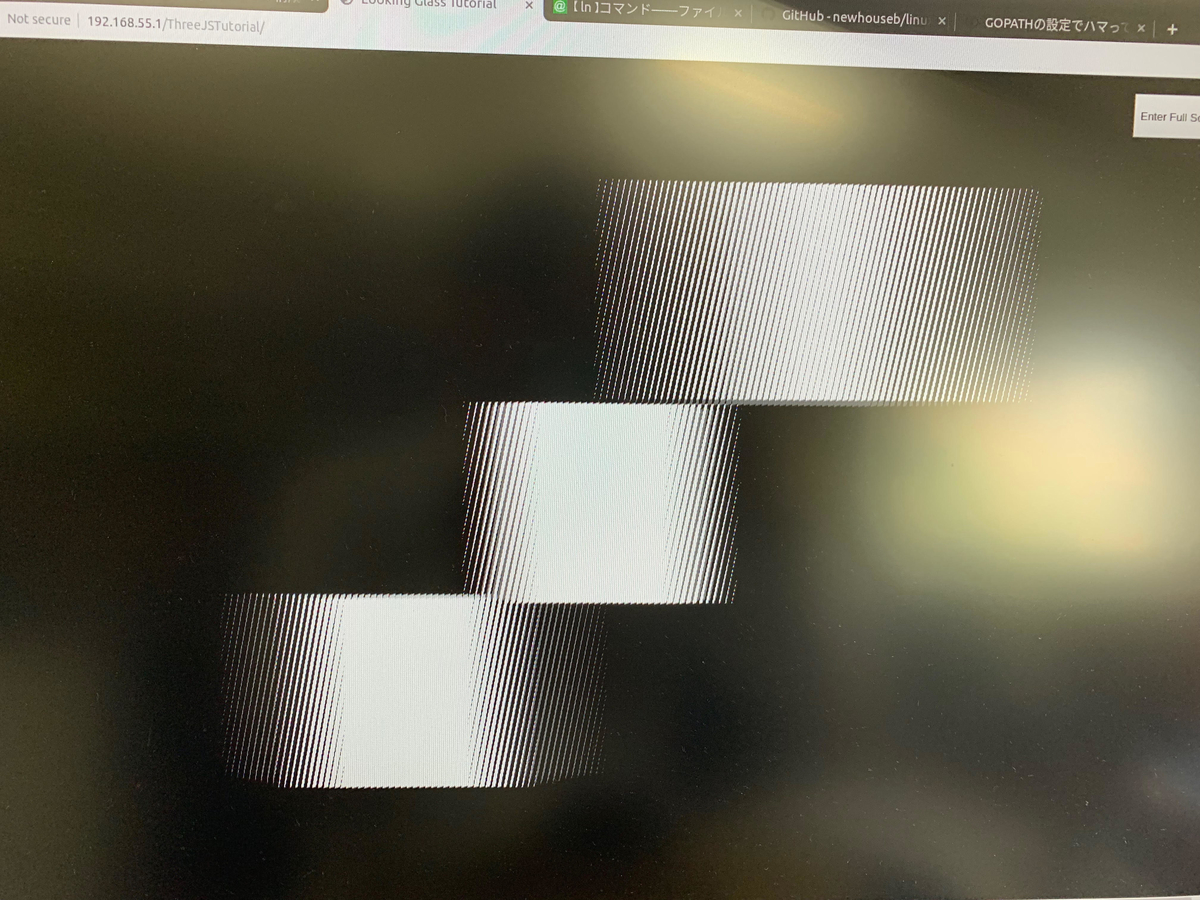

すると、上手くいっていればキャリブレーションデータがターミナルに表示されて、ブラウザ内に次のような画面が表示されます。

うろ覚えで書いているので、上手く動いた動かない、のフィードバックをお待ちしています。

今日の工具

一流工具が欲しい病気にかかっています。

京都機械工具(KTC) ツールセット チェスト 67点組 SK36719X (SK SALE 2019) レッド 67個入

- 出版社/メーカー: 京都機械工具(KTC)

- メディア: Tools & Hardware

- この商品を含むブログを見る

マキタ(Makita) DF484DZ 充電式ドライバドリル 青 本体のみ 18V

- 出版社/メーカー: マキタ(Makita)

- メディア: Tools & Hardware

- この商品を含むブログを見る